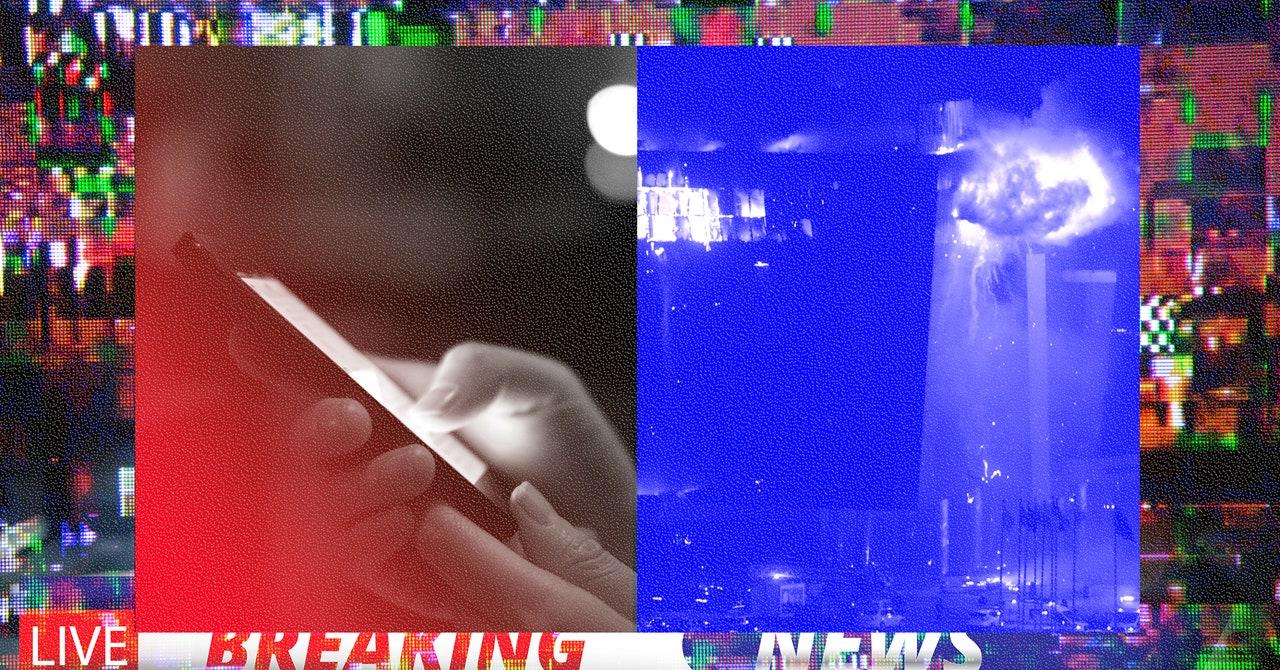

Uma investigação recente revelou um caso chocante de uma “chop shop” de inteligência artificial disfarçada de um site de notícias confiável, que enganou milhões de leitores com conteúdo cheio de erros e informações falsas. A história serve como um alerta sobre os perigos potenciais da desinformação impulsionada pela IA.

Três pontos importantes

- Um site chamado BNN Breaking atraiu milhões de leitores com histórias geradas por IA repletas de erros factuais.

- O site conseguiu um acordo de publicação com a Microsoft, levando a histórias falsas sendo promovidas no MSN.com.

- Um apresentador de rádio irlandês processou o BNN Breaking e a Microsoft por difamação após ter sua imagem erroneamente associada a acusações de má conduta sexual.

A ascensão e queda de um “império” de notícias falsas

Como arquiteto experiente, eu posso afirmar que essa situação é um caso clássico de como a tecnologia, quando mal utilizada, pode ter consequências desastrosas. O BNN Breaking surgiu do nada, afirmando ser um site de notícias legítimo com uma equipe internacional de jornalistas. No entanto, por trás das cortinas, eles estavam usando inteligência artificial para gerar automaticamente conteúdo, resultando em uma avalanche de erros factuais e informações falsas.

Um acordo suspeito com a Microsoft

De alguma forma, esse site obscuro conseguiu um acordo de publicação com a gigante da tecnologia Microsoft. Isso significa que as histórias geradas por IA do BNN Breaking estavam sendo exibidas no MSN.com, um portal da web com milhões de visitantes. Era como se a Microsoft tivesse dado sua aprovação a um tabloide digital cheio de mentiras.

Um apresentador de rádio famoso é difamado

Um dos maiores escândalos envolvendo o BNN Breaking foi quando eles publicaram uma história falsa sobre um “proeminente apresentador de rádio irlandês” enfrentando acusações de má conduta sexual. Eles ilustraram a história com uma foto do apresentador Dave Fanning, da rádio irlandesa RTÉ, mesmo ele não tendo nada a ver com o caso. Essa difamação levou Fanning a processar o BNN Breaking e a Microsoft.

A IA pode ser uma faca de dois gumes

Esse caso serve como um lembrete de que a inteligência artificial, apesar de seu potencial revolucionário, também pode ser perigosa se usada de forma irresponsável. “Você não acreditaria na quantidade de pessoas que entraram em contato comigo por causa disso”, lamentou Fanning sobre o escândalo. A IA pode gerar conteúdo rapidamente, mas também pode espalhar desinformação em escala massiva se não for controlada adequadamente.

A necessidade de regulamentação e ética na IA

Incidentes como esse destacam a urgência de estabelecer regulamentações e diretrizes éticas para o uso da IA na geração de conteúdo. Como arquiteto, sei que a tecnologia é uma ferramenta poderosa, mas precisa ser usada com responsabilidade. Empresas de tecnologia como a Microsoft não podem simplesmente dar luz verde a qualquer conteúdo gerado por IA sem verificação adequada. E sites como o BNN Breaking devem ser responsabilizados por disseminar desinformação com tanta impunidade.

O futuro da IA e do jornalismo

Embora este caso tenha sido um exemplo negativo, existem aplicações positivas da IA no jornalismo, como a capacidade de analisar grandes quantidades de dados e identificar padrões e insights. No entanto, os seres humanos precisam continuar sendo os árbitros finais da precisão e integridade do conteúdo. A IA pode ser uma ferramenta poderosa, mas não pode substituir completamente o julgamento e a ética humana.

Lições aprendidas

Esse escândalo do BNN Breaking deve servir como um alerta para a indústria de tecnologia e para os consumidores de notícias online. Precisamos estar atentos aos perigos da desinformação impulsionada pela IA e exigir transparência e responsabilidade dos criadores de conteúdo. Ao mesmo tempo, não devemos descartar completamente o potencial da IA, mas sim trabalhar para desenvolvê-la de forma ética e responsável.

Conclusão

No final das contas, o caso do BNN Breaking mostra que a inteligência artificial é uma ferramenta poderosa, mas que precisa ser usada com cautela e responsabilidade. Empresas de tecnologia, criadores de conteúdo e até mesmo nós, como consumidores de informação, temos um papel a desempenhar para garantir que a IA não seja usada para disseminar desinformação e prejudicar pessoas inocentes. Com as lições aprendidas desse incidente, podemos trabalhar para construir um futuro em que a IA é uma força para o bem, e não para o mal.